تحوّلت تقنيات التزييف العميق (Deepfake) للذكاء الاصطناعي إلى وسيلةٍ أساسية لنشر المعلومات المضلّلة بسرعة فائقة: من روبوتات الدردشة (Chatbots) التي تنشر الأكاذيب، مروراً بتطبيقات تبديل الوجوه التي تستعمل لتزييف مقاطع فيديو إباحية، وصولاً إلى برامج استنساخ الأصوات بهدف الاحتيال. ضبط هذه التقنية أصبح هدفاً رئيسياً لدولٍ عدة.

مع سيل من الصور التي أنشئت إلكترونياً والفيديوهات التي تظهر أشخاصاً يتفوهون بأشياء لم يقولوها إطلاقاً، جعل الذكاء الاصطناعي المثل القائل “لا تؤمن قبل أن ترى” موضع شك، وأدى إلى تراجع ثقة مزيدٍ من الناس بالمحتوى الموجود على شبكة الإنترنت. العام الماضي على سبيل المثال، انتشرت تغريدة للملياردير الأميركي إيلون ماسك قال فيها: “هذا لست أنا طبعاً”، تعليقاً على فيديو استخدمت فيه تقنية التزييف العميق، يظهره وهو يروّج لعملية احتيالية عبر العملات المشفرة.

تبنت الصين أخيراً قواعد موسّعة لتنظيم التزييف العميق، لكن يبدو أن معظم البلدان تعاني من أجل مواكبة هذه التكنولوجيا سريعة التطور، وسط مخاوف من أن فرض القواعد على هذا المجال قد يعيق الابتكار أو قد يُساء استخدامه للحدّ من حرية التعبير.

ووفقاً لوكالة فرانس برس، يحذّر الخبراء من أنّ برامج التزييف العميق تتفوّق على أجهزة الكشف عنها إلى حد كبير، كما أنّه يصعب اكتشاف مستخدميها لقدرتهم على استعمال برامج الذكاء الاصطناعي المتوفّرة بكلفة منخفضة بشكلٍ سري.

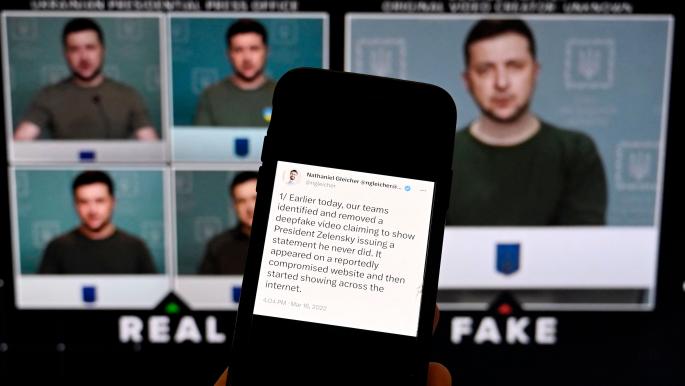

أعلنت شركة ميتا المالكة لتطبيقات واتساب وفيسبوك وإنستغرام، الشهر الماضي، أنّها حذفت مقطع فيديو استعملت فيه تقنية التزييف العميق، يظهر فيه الرئيس الأوكراني فولوديمير زيلينسكي وهو يحثّ مواطني بلاده على إلقاء أسلحتهم والاستسلام للجيش الروسي.

وفي السياق نفسه، قالت الناشطة البريطانية كيت إيزاك (30 عاماً) إنّها أصيبت بالصدمة وخيبة الأمل عندما ظهر وجهها في فيديو إباحي استخدمت فيه تقنية التزييف العميق، ممّا جعلها عرضةً لوابل من الإساءات، بعد نشره من قبل مستخدم غير معروف على منصة تويتر. ونقلت هيئة الإذاعة البريطانية (بي بي سي)، في أكتوبر/ تشرين الأول الماضي، عن إيزاك قولها: “أتذكر تفكيري في أنّ هذا الفيديو سينتشر في كلّ مكان. كان أمراً مروّعاً”. وفي الشهر التالي، أعربت الحكومة البريطانية عن قلقها من التقنية، وحذرت من موقع إلكتروني شهير “يُجرد النساء افتراضياً من ملابسهن”.

“أبوكاليبس المعلومات”

مع عدم وجود عوائق أمام إنشاء نصوص ومقاطع صوتية وفيديو بواسطة الذكاء الاصطناعي، فإنّ احتمال إساءة استخدامها في انتحال الهوية أو الاحتيال المالي أو تشويه السمعة يثير قلقاً عالمياً. قبل فترة، أطلقت مجموعة أوراسيا على أدوات الذكاء الاصطناعي اسم “أسلحة الدمار الشامل”. وحذرت المجموعة في تقرير من أنّ “التقدم التكنولوجي في الذكاء الاصطناعي سيؤدي إلى تآكل الثقة الاجتماعية، وسيمكّن الشعبويين والسلطويين، وسيؤدي إلى تعطيل الأعمال والأسواق”. ونبهت من أن “التقدم في برامج التزييف العميق والتعرف إلى الوجه والتركيب الصوتي ستجعل تحكم الشخص في صورته أمراً من الماضي”.

واعترفت شركة إيليفن لابز الناشئة أمام منظمة العفو الدولية (أمنستي)، هذا الأسبوع، أنّه يمكن إساءة استخدام أداة استنساخ الصوت الخاصة بها “لأغراض خبيثة”، وذلك بعد أن نشر المستخدمون مقطعاً صوتياً مزيفاً للممثلة إيما واتسون وهي تقرأ مقاطع من سيرة الزعيم النازي أدولف هتلر “كفاحي”.

قد يؤدي الاستعمال المتزايد لتقنية التزييف العميق إلى ما وصفته الشرطة الأوروبية (يوروبول) بأنّه “أبوكاليبس المعلومات”، حيث لن يكون بمقدور كثيرٍ من الناس التمييز بين ما هو حقيقي وما هو خيالي. وأعلنت “يوروبول” في تقرير: “يخشى الخبراء أن يقودنا ذلك إلى وضع لا يعود فيه للمواطنين حقيقة مشتركة، أو أنّه قد يخلق ارتباكاً مجتمعياً حول مصادر المعلومات الموثوقة”.

وظهر مثالٌ على ذلك خلال الأسبوع الماضي، عندما تحدّث لاعب كرة القدم الأميركية دامار هاملين إلى معجبيه في مقطع فيديو لأوّل مرة منذ أن تعرض لسكتة قلبية خلال إحدى المباريات. وشكر هاملين في الفيديو الفريق الطبي المسؤول عن شفائه، لكن العديد من المؤمنين بنظريات المؤامرة الذين ألقوا باللوم على لقاح كوفيد-19 في عارضه الصحي شكّكوا بالفيديو، واعتبروا أنّه معد باستخدام تقنية التزييف العميق.

“انتشار فائق السرعة”

فرضت الصين قوانين جديدة، خلال يناير/ كانون الثاني الماضي، تضمنت إجبار الشركات التي تقدم خدمات التزييف العميق على الحصول على الهويات الحقيقية لمستخدميها. كما أمرت بوضع علامات على المحتوى الذي أنشئ باستخدام هذه التقنية، لتجنّب “أيّ ارتباك”. وجاءت هذه القوانين بعد أن اعتبرت الحكومة أنّ التزييف العميق يمثل “خطراً على الأمن القومي والاستقرار الاجتماعي”.

وفي الولايات المتحدة، حيث ضغط المشرعون من أجل تشكيل فريق عمل لمراقبة التزييف العميق، يحذر ناشطو الحقوق الرقمية من وضع تشريعات قد تقتل الابتكار أو تستهدف المحتوى المشروع.

بدوره، يعيش الاتحاد الأوروبي مناقشات ساخنة حول القانون المقترح للذكاء الاصطناعي الذي يطالب المستخدمين بالكشف عن المحتوى المصنوع باستخدام تقنية التزييف العميق.

وقال أستاذ الأبحاث في جامعة سيراكيوز، جيسون ديفيس، لوكالة فرانس برس: “كيف تستعيد الثقة والشفافية عبر الإنترنت؟ هذا هو السؤال الحقيقي الآن”. وأضاف: “أدوات (كشف المزيف من الأصلي) تتطوّر بسرعة نسبياً، لكن تكنولوجيا التزييف العميق تتحرك ربّما بشكل أسرع. لذا لن نصل إلى حل بخصوص الأمن السيبراني، وكلّ ما يمكننا فعله هو أن نحاول مواكبة تطوّراته”.

يكافح الكثيرون بالفعل لفهم التطورات مثل ChatGPT، وهو روبوت محادثة أنشأته الشركة الأميركية أوبن إيه آي OpenAI، وقادرٌ على كتابة نصوص مفهومة ومقنعة حول أيّ موضوع تقريباً. وأشارت مؤسسة نيوزغارد في دراسة إلى أنّ معظم ردود روبوتات الدردشة على النقاشات المرتبطة بقضايا مثل كوفيد-19 وإطلاق النار في المدارس كانت “بليغة وكاذبة ومضللة”. وتابعت: “النتائج تؤكد المخاوف حول إمكانية تحوّل أدوات من هذا النوع إلى أسلحة حين تصل إلى الأيدي الخطأ”.

(العربي الجديد)